虽然 OpenClaw 内置了主流大模型厂商的快速入口,但对于追求极致性价比和国产大语言模型(LLM)能力的开发者来说,如何通过“Custom Provider”接入阿里云百炼(Aliyun Bailian)等第三方平台依然是个“隐藏关卡”。本文将基于 OpenClaw 2026.3.7 版本,详细拆解如何利用百炼的兼容模式 API,在 OpenClaw 中跑通通义千问(Qwen)系列模型。

为什么选择自定义接入?

在 OpenClaw 的 onboard 引导菜单中,你会看到 OpenAI、Anthropic 甚至很多新兴厂商的直连选项。然而,当你想使用阿里云百炼平台(提供极具性价比的 Qwen API系列)时,你会发现它并不在默认的第一梯队列表里。如果你和我一样不想用Qwen Code和阿里云Coding Plan,只想用标准API,那么,这篇文正值得借鉴。

学会配置 Custom Provider,不仅能让你用上百炼,还能让你灵活对接任何支持 OpenAI 或 Anthropic 协议的标准网关。

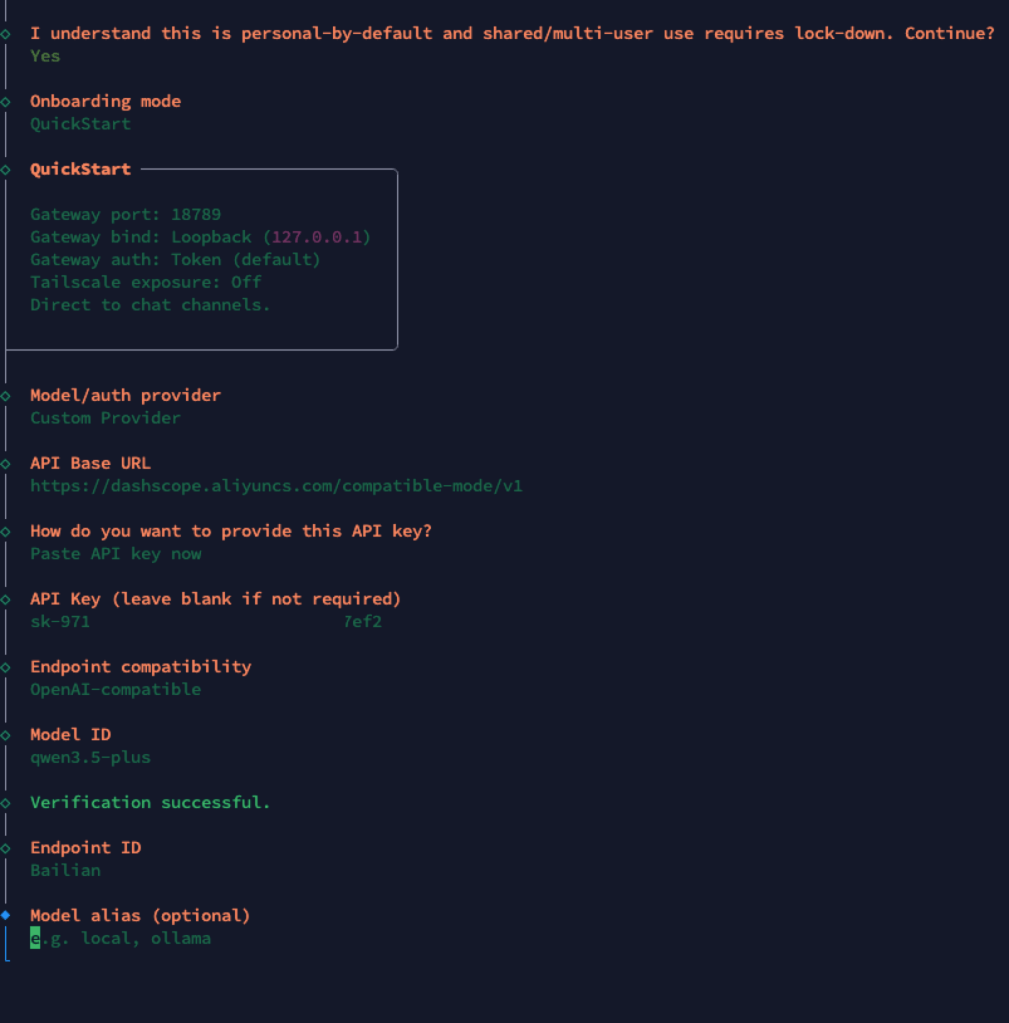

第一步:初始化与安全确认

在终端输入 openclaw onboard 开启配置之旅。

注意: OpenClaw 作为一个拥有文件读写和工具执行权限的 Personal Agent,其安全性至关重要。在正式配置前,你会看到一段详尽的安全声明。

- 核心要点:OpenClaw 默认是单用户信任边界,如果你打算在多用户环境或公网暴露,请务必阅读其安全加固文档。

第二步:锁定 Custom Provider

在 Model/auth provider 列表底部,找到并选择:

- ● Custom Provider (Any OpenAI or Anthropic compatible endpoint)

这是配置国产大模型厂商的关键入口,它允许我们通过“兼容模式”来对接百炼的 API。

第三步:填写百炼核心参数

这是最关键的配置环节,请参考以下参数进行填写:

1. OpenAI 兼容模式(推荐)

这是最通用的配置方式,能完美适配 OpenClaw 的内置逻辑。

| 配置项 | 参数值 |

|---|---|

| API Base URL | https://dashscope.aliyuncs.com/compatible-mode/v1 |

| API Key | sk-xxxxxxxxxx (从阿里云百炼控制台获取) |

| Compatibility | OpenAI-compatible |

| Model ID | qwen3.5-plus (或你购买的其他模型 ID) |

| Endpoint ID | Bailian (可自定义,用于区分不同网关) |

2. Anthropic 兼容模式(进阶)

如果你更倾向于使用 Anthropic 的协议风格,阿里云同样提供了支持:

- • Base URL:

https://dashscope.aliyuncs.com/apps/anthropic(注意这个地址和Coding Plan的地址不一样,也是我踩坑的原因) - • Model ID:

qwen3.5-plus

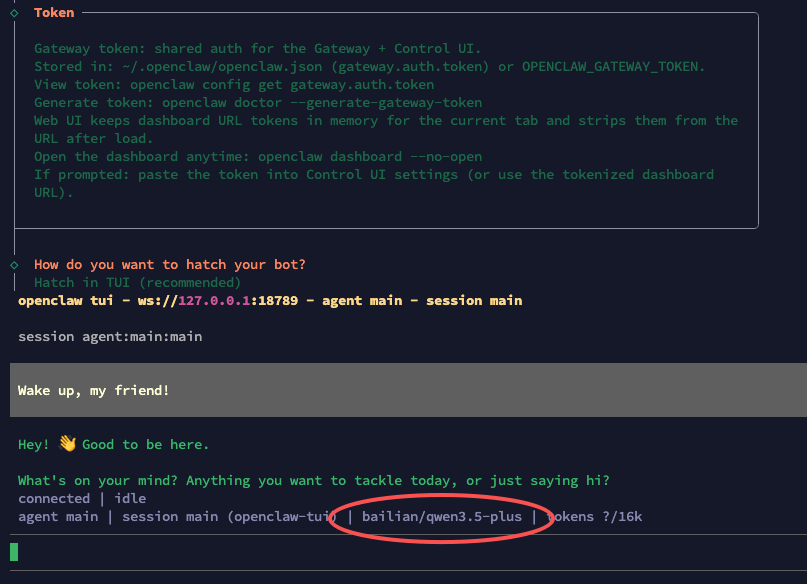

第四步:唤醒你的 Bot

完成配置并显示 Verification successful 后,你可以通过以下命令直接进入交互界面:

openclaw tui

在 TUI 界面底部,你应该能清晰地看到模型状态标识,例如:| bailian/qwen3.5-plus | tokens ?/16k

当看到 “Hey! 👋 Good to be here.” 的回复时,恭喜你,你的 OpenClaw 已经成功挂载了阿里云百炼的大脑!

避坑小贴士

- API 地址别填错:注意百炼的 OpenAI 兼容地址末尾一定要带

/v1。 - 模型 ID 一致性:在

Model ID这一项中,请确保填写的是百炼后台准确的模型编码(如qwen-max,qwen-plus等),否则会报 404 错误。 - 安全审计:建议定期运行

openclaw security audit --deep来检查你的配置环境是否稳固。

结语

配置自定义厂商虽然多走了两步,但它为你打开了自由选择模型底座的大门。无论是阿里云百炼的 Qwen 系列,还是其他国产大模型,只要符合标准协议,都能成为你 OpenClaw 助手的强大动力。

希望这篇文章能帮到你!如果你需要我针对其中的某个步骤(比如 API Key 的获取细节)进行扩充,或者想增加一些更极客的配置对比,随时告诉我。

留下评论